HONOR ha anunciado que su tecnología de detección de deepfakes basada en inteligencia artificial estará disponible a nivel mundial a partir de abril de 2025.

Este sistema de detección en tiempo real permitirá a los usuarios identificar contenido manipulado en imágenes y videos mediante el análisis de inconsistencias imperceptibles para el ojo humano. Con esta iniciativa, HONOR se suma a los esfuerzos del sector tecnológico para frenar el uso fraudulento de la IA en la generación de contenido engañoso.

El crecimiento de los deepfakes y su impacto en la seguridad digital

El uso de deepfakes ha aumentado de manera exponencial en los últimos años, representando un desafío significativo para empresas y usuarios. Según datos del Instituto de Ciberseguridad Entrust, en 2024 se produce un ataque deepfake cada cinco minutos. Además, el número de falsificaciones digitales ha experimentado un incremento interanual del 244% respecto a 2023.

Las empresas están entre las principales víctimas de este fenómeno: el 49% de las organizaciones encuestadas experimentaron ataques de deepfake en audio y video entre noviembre de 2023 y noviembre de 2024. A pesar de estos riesgos, un 61% de los ejecutivos admiten no haber implementado protocolos específicos para abordar esta amenaza en sus compañías.

Este crecimiento acelerado se ha reflejado especialmente en sectores altamente digitalizados, como el gaming (1520%), los marketplaces (900%), el sector financiero (fintech, 533%), las criptomonedas (217%) y el ámbito de la consultoría (138%).

HONOR y su apuesta por la detección de deepfakes

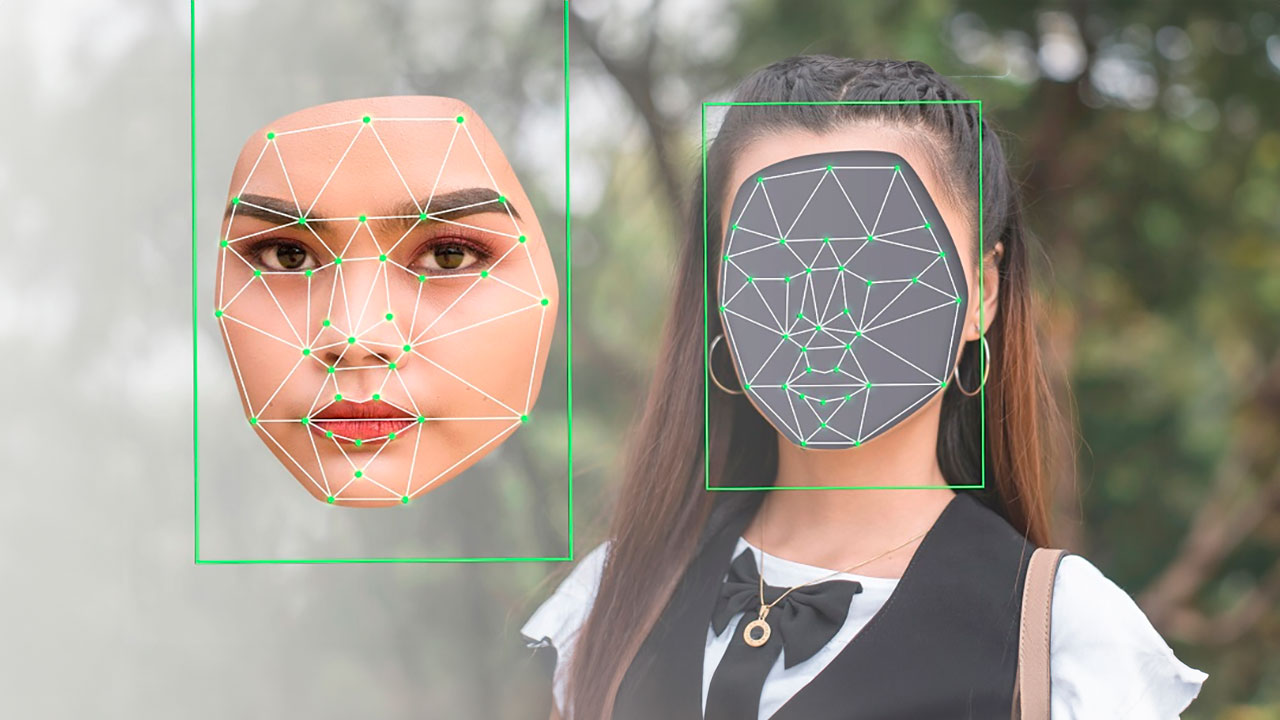

Ante este escenario, HONOR ha desarrollado su tecnología AI Deepfake Detection, la cual se presentó oficialmente en la feria tecnológica IFA 2024. La solución emplea inteligencia artificial para identificar artefactos visuales y anomalías en el contenido digital, analizando aspectos como la coherencia entre fotogramas, la iluminación, la claridad de la imagen y la continuidad en los rasgos faciales y peinados.

Si la herramienta detecta contenido manipulado, emitirá una advertencia inmediata para alertar al usuario y evitar una interacción prolongada con material fraudulento. Con este desarrollo, HONOR busca proporcionar una capa adicional de seguridad a los consumidores en un entorno donde la autenticidad del contenido es cada vez más difícil de determinar.

Estándares de autenticidad y otras medidas del sector

La lucha contra los deepfakes no depende exclusivamente de la detección automática. Organizaciones como el Content Provenance and Authenticity (C2PA) han trabajado en la creación de estándares técnicos para certificar el origen y la integridad de los contenidos digitales, incluyendo aquellos generados mediante IA.

Empresas como Adobe, Intel, Microsoft y Truepic han colaborado en el desarrollo de soluciones para la autenticidad del contenido. Microsoft, por ejemplo, ha implementado controles basados en IA para difuminar rostros en imágenes subidas a Copilot, mientras que la tecnología de Qualcomm permite verificar y sellar criptográficamente el contenido multimedia en el momento de su creación.

El mercado global de detección de deepfakes sigue en expansión. Según estimaciones de Deloitte, se espera que este sector crezca a una tasa anual del 42%, alcanzando los 15.700 millones de dólares en 2026, frente a los 5.500 millones de dólares registrados en 2023.

Perspectivas y desafíos en la identificación de deepfakes

El avance de la inteligencia artificial ha generado tanto oportunidades como desafíos en la verificación de contenidos. Un estudio de Deloitte sobre consumidores conectados en 2024 indica que el 59% de los encuestados tienen dificultades para distinguir entre contenido real y generado por IA. Además, el 84% de los usuarios familiarizados con la IA generativa considera que estos contenidos deberían ser etiquetados para garantizar mayor transparencia.

En este contexto, HONOR apuesta por una estrategia de protección centrada en la combinación de inteligencia artificial y concienciación del usuario. A medida que la tecnología avance, la implementación de normativas y herramientas de detección jugará un papel clave en la prevención de fraudes y desinformación en el ecosistema digital.