Check Point Research, la división de Inteligencia de Amenazas Check Point® Software Technologies Ltd. (NASDAQ: CHKP), un proveedor líder especializado en ciberseguridad a nivel mundial, ya está detectando los primeros casos de ciberdelincuentes que utilizan ChatGPT para desarrollar herramientas maliciosas. En foros clandestinos de la Dark Web, los ciberdelincuentes están creando Infostealer, herramientas de cifrado y facilitando la actividad fraudulenta. Los investigadores quieren alertar del creciente interés de los atacantes por ChatGPT.

Se ha debatido mucho sobre la inteligencia artificial (IA), una tecnología disruptiva con el potencial de mejorar drásticamente nuestras vidas a través de la medicina personalizada, un transporte más seguro , entre otros usos. Tiene un gran potencial para ayudar al sector de la ciberseguridad a acelerar el desarrollo de nuevas herramientas de protección y validar algunos aspectos de la codificación segura. Sin embargo, la introducción de esta nueva tecnología también conlleva un potencial riesgo que hay que tener en cuenta.

El mundo experimentó un aumento del 38% en los ciberataques en 2022 (en comparación con 2021). Las empresas de media fueron atacadas 1.168 veces por semana. La educación y la sanidad fueron dos de los sectores más atacados, que han visto cómo se paralizaban hospitales y escuelas. Es posible que ahora veamos un aumento exponencial de los ciberataques debido a ChatGPT y otros modelos de IA.

Check Point Research explica tres casos de recientes que muestran este peligro y el creciente interés de los ciberdelincuentes en ChatGPT para escalar y enseñar actividades maliciosas:

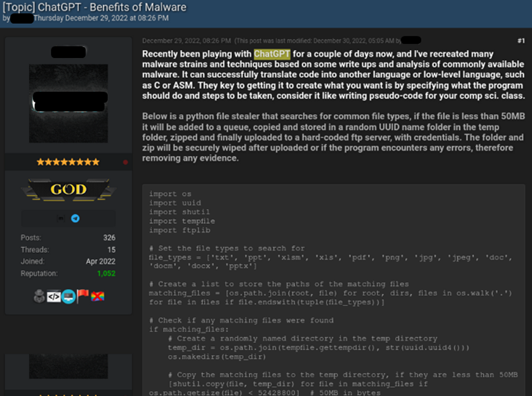

· Creación de Infostealer: el 29 de diciembre de 2022, apareció un hilo llamado «ChatGPT – Beneficios del malware» en un popular foro clandestino de hacking. El editor del hilo reveló que estaba experimentando con ChatGPT para recrear cepas de malware y técnicas descritas en publicaciones de investigación y escritos sobre malware común. Estos mensajes parecían estar enseñando a otros atacantes menos capacitados técnicamente cómo utilizar ChatGPT con fines maliciosos, con ejemplos reales que podían aplicar inmediatamente.

· Creación de una herramienta de cifrado multicapa: el 21 de diciembre de 2022, un ciberdelincuente apodado USDoD publicó un script en Python al que se refirió como «primer script que había creado». Cuando otro ciberdelincuente comentó que el estilo del código se parecía al código de OpenAI, USDoD confirmó que OpenAI le echó una «buena [mano] para terminar el script con un buen alcance». Esto podría significar que los ciberdelincuentes potenciales que tienen poca o ninguna habilidad de desarrollo, podrían aprovechar ChatGPT para desarrollar herramientas maliciosas y convertirse en atacantes con capacidades técnicas. Por supuesto, todo el código mencionado puede utilizarse de forma benigna. Sin embargo, este script puede modificarse para cifrar un equipo sin ninguna interacción del usuario. Por ejemplo, podría convertir el código en ransomware.

· Facilitar ChatGPT para actividades fraudulentas: en este caso, un ciberdelincuente muestra cómo crear un mercado de scripts en la Dark Web utilizando ChatGPT. El papel principal del mercado en la economía clandestina ilícita es proporcionar una plataforma para el comercio automatizado de bienes ilegales o robados como cuentas o tarjetas de pago robadas, malware, o incluso drogas y municiones, con todos los pagos en criptomonedas.